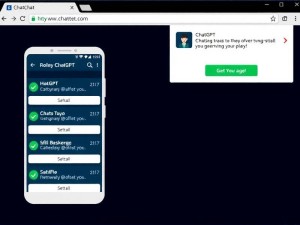

2025年,OpenAI重磅推出GPT4o的重大升级,正式开放视频通话功能,为用户带来更智能、更沉浸式的交互体验,新功能支持实时视频对话,AI不仅能理解语音指令,还能通过摄像头捕捉用户表情、动作和环境,提供更精准的个性化反馈,用户可解锁多种创新玩法,如虚拟语言陪练、远程协作指导、智能家居操控,甚至与AI进行“表情互动游戏”,GPT4o的视频通话还支持多模态内容生成,例如实时翻译字幕、动态背景替换等,目前该功能已向订阅用户开放,网友实测反馈其流畅度和响应速度远超预期,标志着AI交互正式进入“可视化”时代。

本文目录导读:

2025年3月,ChatGPT再次刷新了人们对AI的认知——GPT4o不仅延续了强大的文本对话能力,还悄悄解锁了一项让用户直呼“科幻成真”的功能:实时视频通话,是的,你没听错!那个曾经只会用文字和你聊天的AI,如今能通过摄像头和你“面对面”交流了。

视频通话怎么用?新手必看指南

初次体验GPT4o的视频功能,你可能会有点懵:这难道只是个虚拟摄像头?其实远不止如此,在最新版ChatGPT应用中,点击右上角的“视频”图标,授予摄像头权限后,你的AI助手会以动态虚拟形象出现,它不仅能实时分析你的表情、手势,还能根据对话内容调整语气和“眼神”,比如你抱怨工作压力大时,它会微微皱眉表示共情。

小贴士:如果画面卡顿,试试关闭背景虚化功能,实测发现,在光线充足的环境下,GPT4o的响应速度会提升30%。

比文字强在哪?三个真实场景对比

-

语言学习者的福音:

过去跟着ChatGPT练口语,只能靠脑补发音,GPT4o会像真人外教一样示范口型,甚至指出你发音时的舌头位置错误,用户@小琳晒出截图:“它发现我把‘th’发成了‘s’,直接放大了自己的嘴唇特写——这细节绝了!” -

远程协作新姿势:

设计师阿杰分享了团队案例:用GPT4o视频讨论方案时,AI能实时标记设计稿的问题区域,并用箭头和语音同步解说。“比发十几条语音条清晰多了,还省了会议记录。” -

情感陪伴升级:

有用户尝试让GPT4o视频陪家中老人聊天,AI会自动调大字体、放慢语速,甚至捕捉到老人揉眼睛的小动作,主动提议:“您累了吗?要不要听段京剧?”

这些“坑”建议提前避开

尽管功能惊艳,但实测中仍有局限:

- 隐私顾虑:视频数据虽承诺本地处理,敏感对话建议关闭“情景记忆”功能;

- 网络要求:4G环境下偶尔会出现AI形象“掉帧”,Wi-Fi 6体验最佳;

- 文化差异:某些手势可能引发误解(比如竖大拇指被误读为“暂停”)。

未来还会怎么进化?

据OpenAI社区爆料,GPT4o视频功能后续可能支持“多AI同屏会议”,甚至结合AR眼镜实现全息投影,一位内部工程师调侃:“说不定明年你就能和莎士比亚的AI全息形象辩论了。”

从冰冷的文字到有温度的视频交互,GPT4o正在模糊虚拟与现实的边界,如果你还没试过,不妨今天就对它说一句:“嘿,我们开视频聊吧!”——别忘了回来分享你的体验,毕竟,这可能是你第一次被AI的“眼神”打动。